picgo配合SMMS构建自己免费的图床

在SMMS中注册账户

注册账户,smms的访问地址: https://sm.ms/

注册好之后,获取smms中的token值

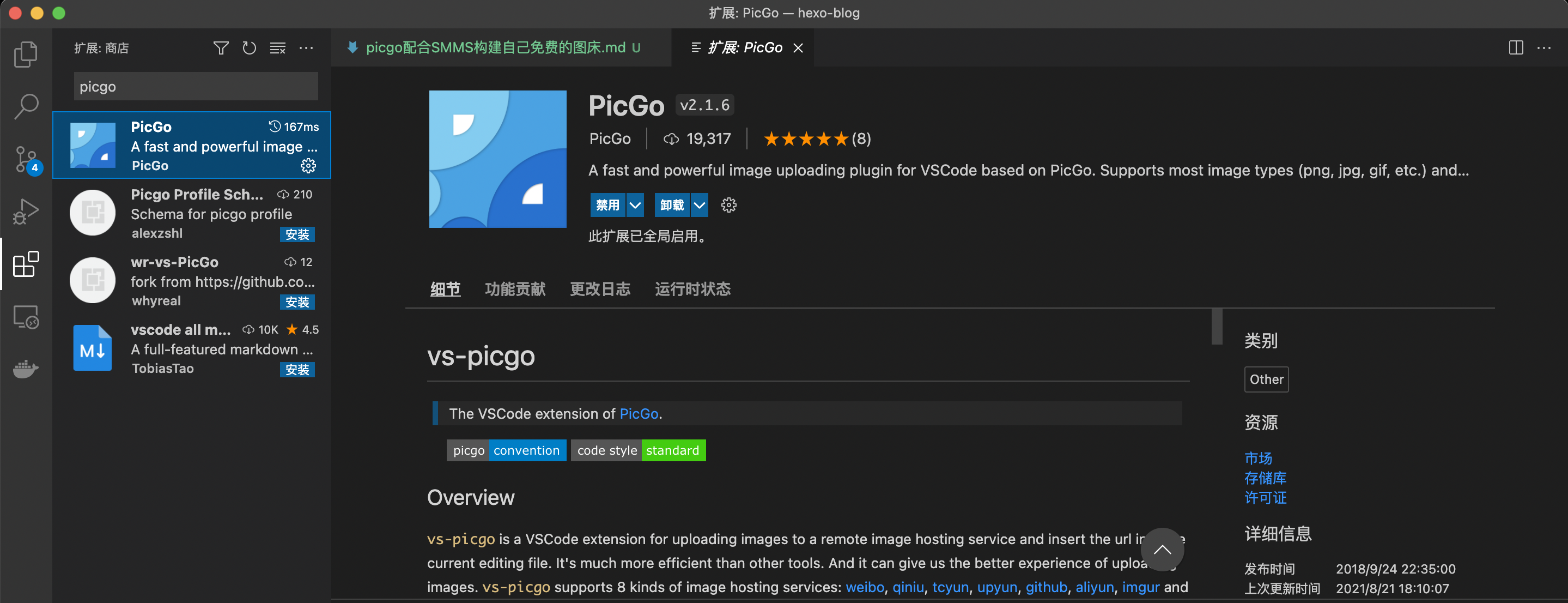

在vsCode中使用picGo

安装picGo插件

修改配置,搜索smms,填写自己的smms中的token值

保存后,即可上传文件,操作如下:

① 截图操作后,图片保存在了粘贴板中

② mac 用户的上传图片的快捷键是:option + command + u

1windowns 用户上传图片的快捷键:ctrl + alt + u

③ 上传后,vscode界面的又下角可看到如下浮动窗口

④ 并在smms中可以看到上传的图片

参考网址【图床搭配 PicGo:打造高效的图片处理工作流】https://sspai.com/post/65716【比PicGo更好用的是VSCode里的PicGo插件】https://kouss.com/2019-7-11【SMMS网址】https://sm.ms/

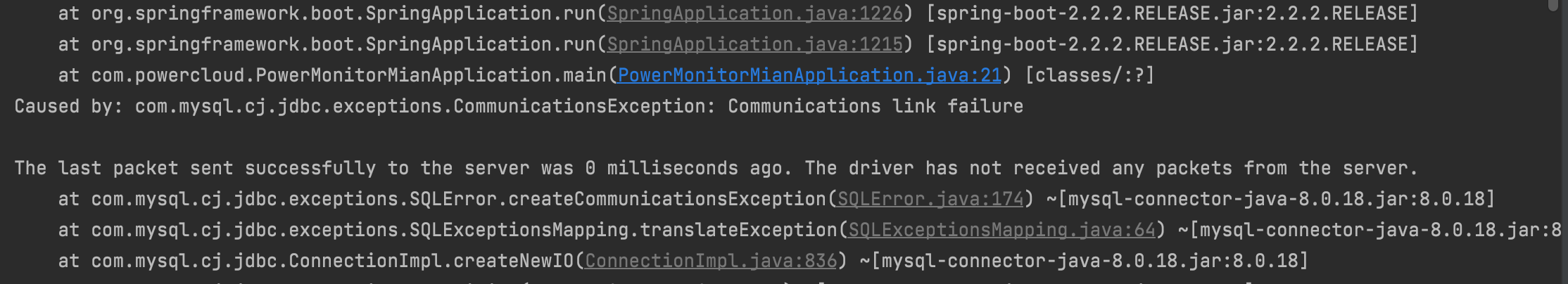

【BUG记录】Java连接mysql数据库报错:Communications link failure

问题描述java项目(springboot)连接mysql出现如下错误:

1Caused by: com.mysql.cj.jdbc.exceptions.CommunicationsException: Communications link failure

项目中配置的jdbc连接地址如下:

12druid.url=jdbc:log4jdbc:mysql://172.18.xxx.xxx:3306/xxxxdb?useUnicode=true&characterEncoding=utf8&serverTimezone=UTC

但是通过navicat等工具可以正常的连接

原因查了很多资料,发现在MySQL5.7之前的版本,安全性较低,存在任何用户都可以连接上的 test 库,所以官方在5.7版本加大了对隐私的保护。并且采用了默认 useSSL = true值防止对数据库的随意修改,到了8.0版本,仍然保留了SSL,并且默认值为 true,所以只要将 “?useSSL= false” 放在url表名后即可

解决办法在配置的jdbc连接地址末尾带上如下参数即可 ...

各系统下无限重置IDEA试用版本

在Ubuntu(linux)下重置先说一下原理,在2021.2.3版本之前,我们本机使用IDEA是不需要登录什么账户的,因此IDEA无法讲试用时间的限制放在云端,也就是说,IDEA的试用时间的限制数据是放在我们本地的,只需要找到IDEA存放在我们本地的时间限制数据,并删掉就可以重置试用时间;下面就开始吧。

第一步,我们需要找到IDEA 的数据存放在哪儿

经过一番寻找,终于到找了,数据目录在我们用户目录下的 .config/JetBrains/ 目录下:

由于没办法区分那些文件是用来存放时间限制的,我们可以一把全部删掉,相当于重新安装

最新发现,只需要删除 /home/yefan/.config/JetBrains/IntelliJIdea2021.2/eval 目录下的文件即可

删除后再重启IDEA,就可以发现IDEA跟新安装一样

evaluation.key

到这里就完成了重置

这种方式同样适用于所有 JetBrains 的其他产品,但是要求版本是在 2021.2 版本以前

在windows下重置路径如下:

C:\Users\zq\AppData\Roamin ...

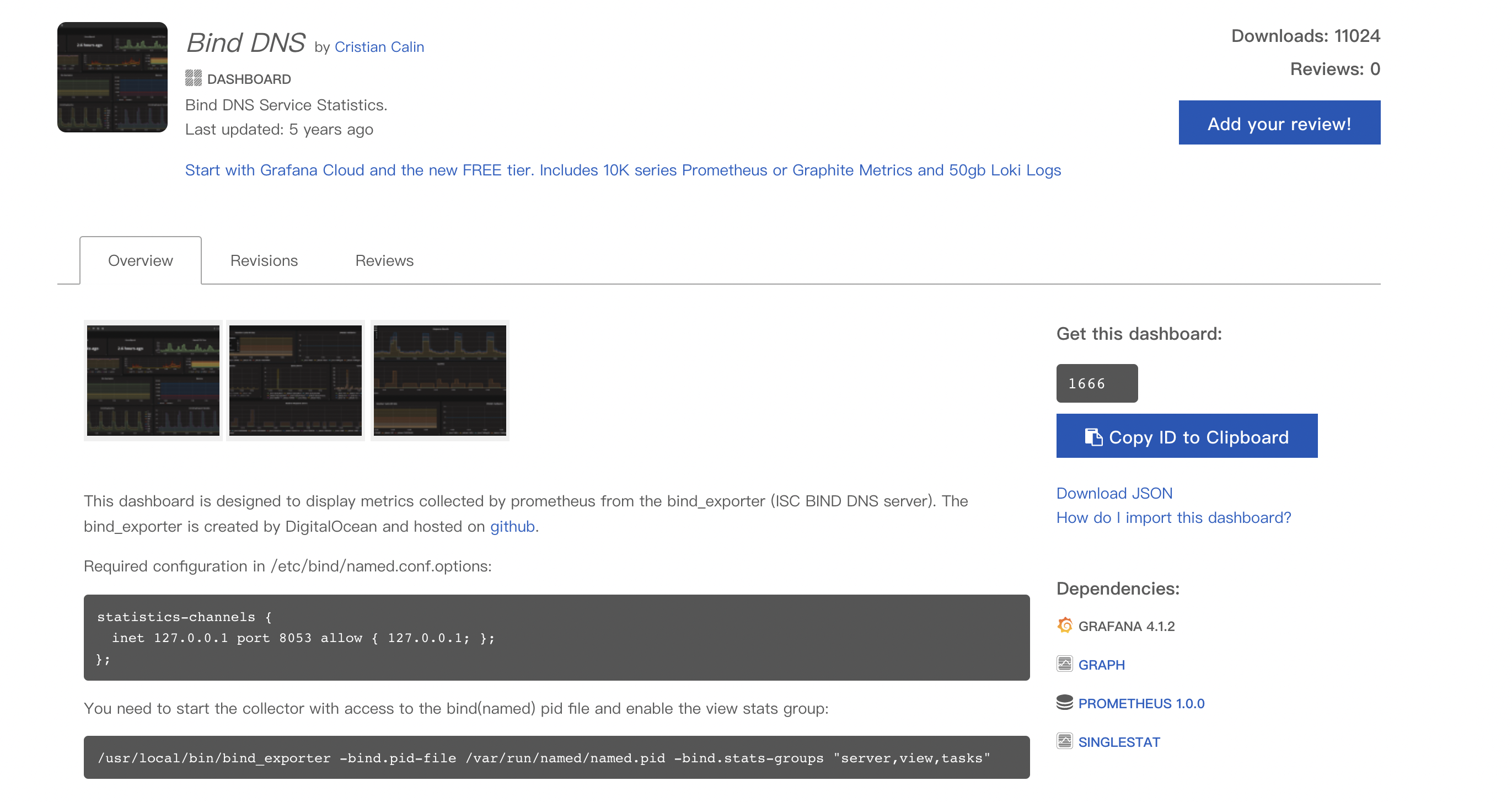

bind-exporter的部署

安装部署exporter下载exporter二进制包根据不同的环境,选择不同的二进制包

下载地址:https://github.com/prometheus-community/bind_exporter/releases/tag/v0.5.0

我这里使用的是这个包【bind_exporter-0.5.0.linux-amd64.tar.gz】

https://github.com/prometheus-community/bind_exporter/releases/download/v0.5.0/bind_exporter-0.5.0.linux-amd64.tar.gz

解压安装包1tar -zxvf bind_exporter-0.5.0.linux-amd64.tar.gz

解压之后的目录结构如下:

运行exporter进入解压的目录,运行二进制文件 bind_exporter

1./bind_exporter --bind.pid-file=/var/run/named/named.pid --bind.timeout=20s --web.listen-address ...

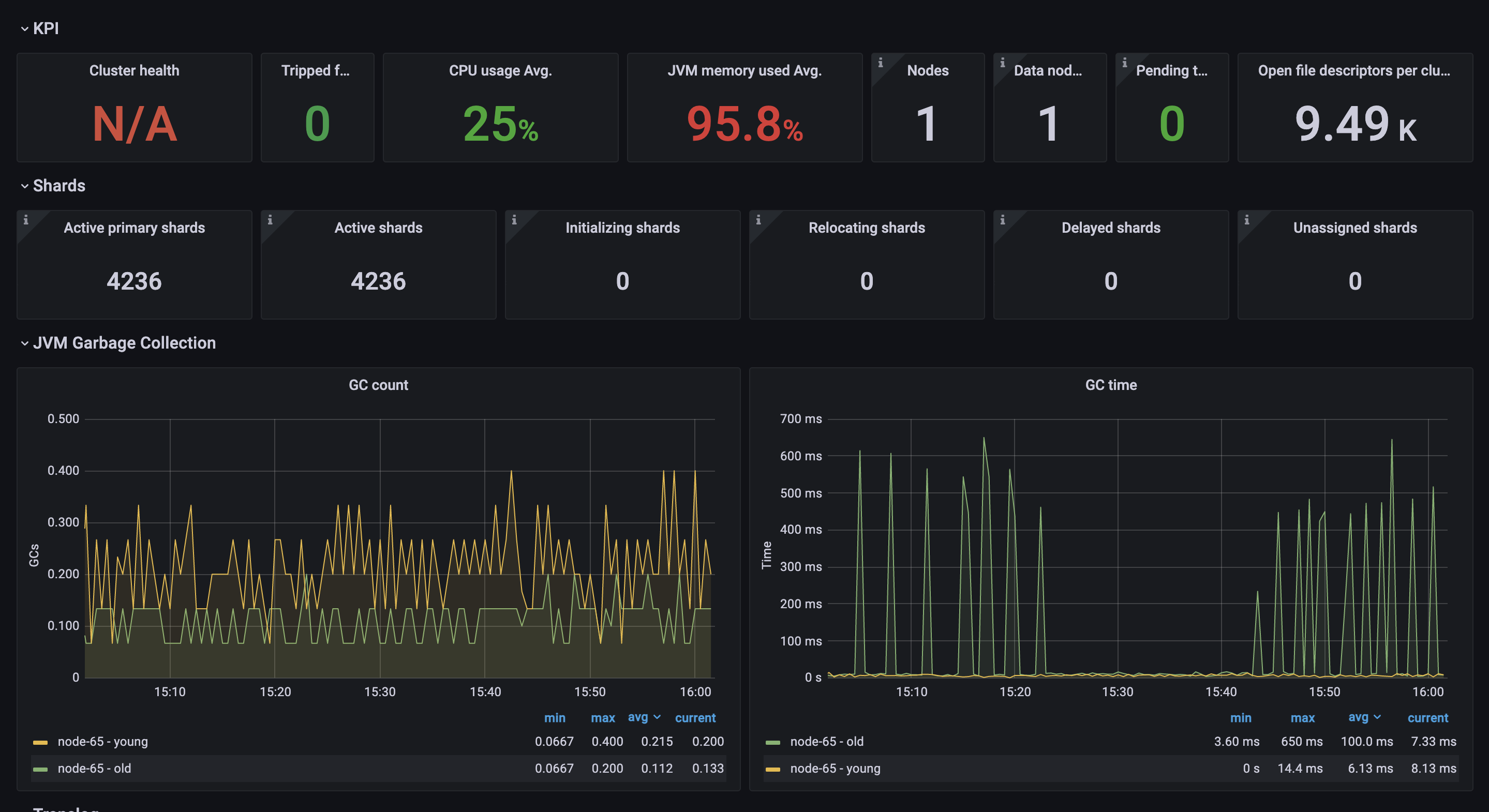

elasticsearch-exporter的部署

安装部署exporter下载exporter二进制包根据不同的环境,选择不同的二进制包

下载地址:https://github.com/prometheus-community/elasticsearch_exporter/releases/tag/v1.3.0

我这里使用的是这个包【elasticsearch_exporter-1.3.0.linux-amd64.tar.gz】

https://github.com/prometheus-community/elasticsearch_exporter/releases/download/v1.3.0/elasticsearch_exporter-1.3.0.linux-amd64.tar.gz

解压安装包1tar -zxvf elasticsearch_exporter-1.3.0.linux-amd64.tar.gz

解压之后的目录结构如下:

运行exporter进入解压的目录,运行二进制文件 elasticsearch_exporter

根据被监控的elasticsearch是否用户密码,需要分为以下两种情况进行运行:

...

prometheus监控之node各项指标

根据node-exporter采集的指标得到想要的指标

所有node节点的磁盘大小总和

1234type:SinglestatUnit: bytesmetrics:sum(node_filesystem_size_bytes{device=~"/.*"})

所有node节点的内存大小总和

1234type:SinglestatUnit: bytesmetrics:sum(node_memory_MemTotal_bytes)

所有node节点的CPU大小总和

1234type:SinglestatUnit: bytesmetrics:count(node_cpu_seconds_total{mode='system'})

node-exporter采集的指标

img-test

用于测试图片是否可以正常展示

操作步骤:

在_config.yml 中修改如下配置为 true1post_asset_folder: true

文章中使用图片

第一种可以使用,makedown的格式 1

第二种 使用如下方式 1{% asset_img image-20220106104706904.png This is an image %}

注意:其中的 image-20220106104706904.png 为需要展示的图片名称,该图片会放在与当前博客同名的目录下面

新的第一篇博客

开始新的博客这里使用github+hexo搭建了自己的博客,参考了如下的博客文章:[GitHub Pages + Hexo搭建个人博客网站,史上最全教程] https://blog.csdn.net/yaorongke/article/details/119089190

hexo操作

创建新博客文档1hexo new '博客文章标题'

生成html文件1hexo g

发布到github1hexo d

启动本地1hexo s

在不同机器上更新博客

在新机器上安装npm

1# 这里根据不同的系统进行安装

安装hexo

1npm install hexo-cli -g

拉取github上面的项目

1git clone git@github.com:xxxxx/xxx.git

然后即可在博客的根目录下使用hexo进行操作

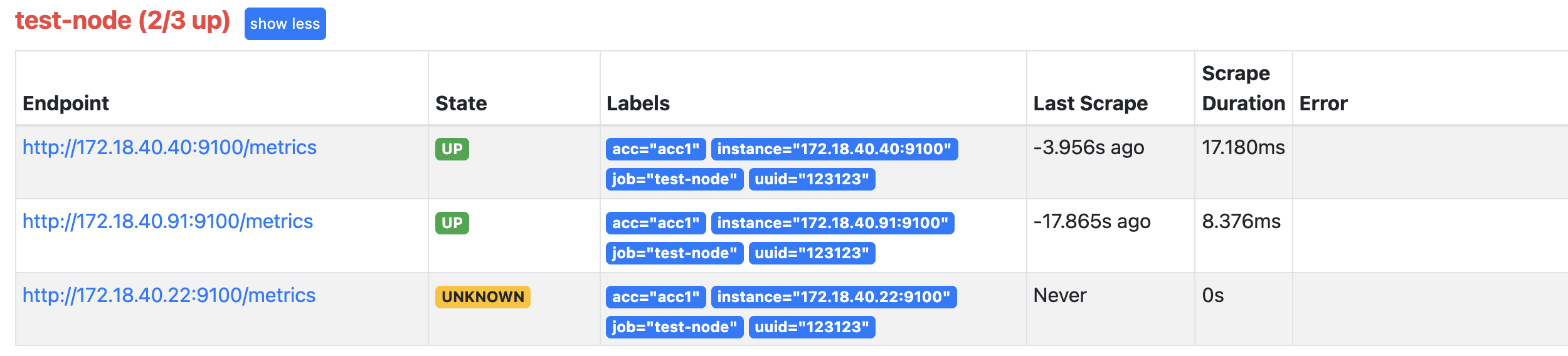

prometheus服务动态发现之http_sd_config

prometheus提供了多种动态服务发现的方式,这里讲一下http_sd_config的配置方法

官方说明先来看下prometheus官方文档的说明

大致就是说:需要自己提供一个http访问地址,prometheus能够通过访问该地址得到需要发现的服务节点的数据,并且该地址返回的json数据结构要与图中保持一致。

配置说明再来看下关于该选项有哪些配置项:

123456789101112131415161718192021222324252627282930313233343536373839# 获取目标服务的地址url: <string># 刷新频率,间隔多久再次调用url获取目标服务[ refresh_interval: <duration> | default = 60s ]# API服务器的身份验证信息,用于访问url时验证身份用# 下面这几项 `basic_auth`, `authorization` 、`oauth2` 是互斥的,也就是说只需要根据具体情况配一项身份验证的方式就可以# 可选的HTTP基本认证信息。其中 `password` and ...

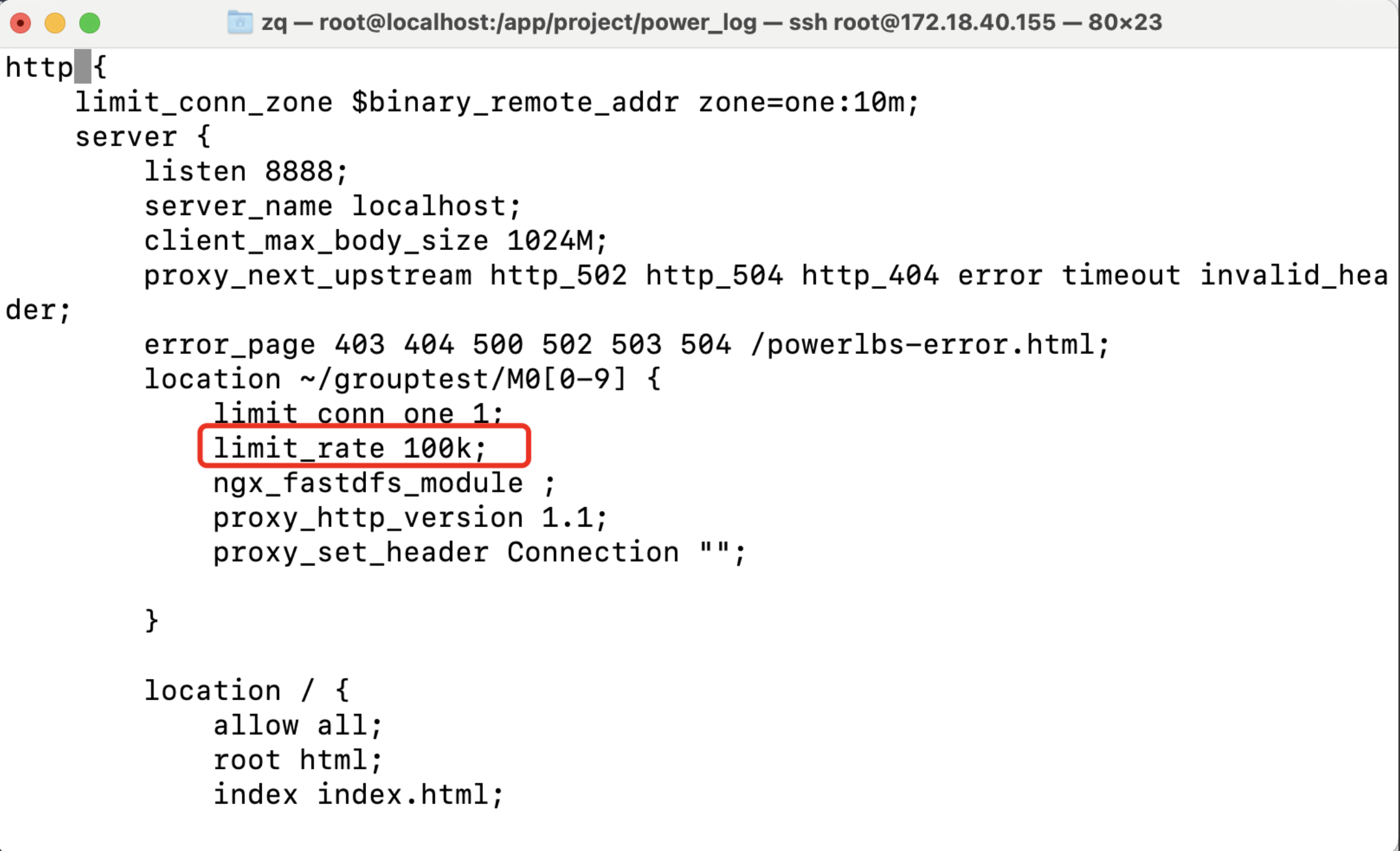

Nginx访问限制配置

限制下载速度1234location xxx { limit_rate 100k; ... }

重启nginx后,可以发现下载速度,确实被限制在 100k/s 左右

限制并发数添加如下两行参数

12345678910http{ limit_conn_zone $binary_remote_addr zone=one:10m; ... service{ ... location xxx{ limit_conn one 1; } }}